Technologie

•

9 min

Zwei Jahre lang lautete der Reflex in KI-Projekten: Frontier-Modell rein, fertig. 2026 wird Modell-Orchestrierung zum entscheidenden Effizienzhebel. Wer jetzt nicht differenziert, zahlt doppelt.

Nicolas Bartschat

Nicolas Bartschat ist Gründer und Geschäftsführer der AI CONSULT GmbH. Er berät Organisationen bei der Einführung von KI- und Automatisierungslösungen mit Fokus auf Praxistauglichkeit und messbarem ROI.

OpenAI hat im ersten Halbjahr 2025 einen Nettoverlust von rund 13,5 Milliarden US-Dollar ausgewiesen und plant für 2028 rund 74 Milliarden US-Dollar an operativen Verlusten (1). Anthropic peilt im selben Jahr den Break-even an, mit aktuell rund 19 Milliarden US-Dollar Annualized Revenue (2). Beide Häuser stehen unter immensem Monetarisierungsdruck. Die Folge ist nicht der laute Preisaufschlag, sondern die subtile Verteuerung. Neue Tokenizer, die für denselben Text bis zu 35 % mehr Tokens erzeugen (3). Wöchentliche Rate Limits, die zuvor unbegrenzte Nutzungsmuster beenden (4). Long-Context-Aufschläge, die ab 200.000 Tokens den Inputpreis verdoppeln (5).

Wer KI-Lösungen produktiv betreibt, spürt diese Entwicklung längst in der Monatsabrechnung. Gleichzeitig sind die Modelle so gut geworden, dass die zweitbeste Klasse heute Aufgaben übernimmt, für die vor 18 Monaten nur das Flaggschiff infrage kam. Aus diesen zwei Bewegungen ergibt sich die zentrale Erkenntnis: Der Reflex „immer das stärkste Modell“ ist betriebswirtschaftlich nicht mehr haltbar. An seine Stelle tritt eine bewusste Modell-Triage.

Warum der Modell-Maximalismus jetzt kippt

Die Anbieter verbrennen Geld in einem Tempo, das auf Dauer nur durch höhere Realpreise gegenfinanzierbar ist. OpenAI verbrennt aktuell rund 1,69 US-Dollar für jeden Dollar Umsatz (1). Das Geld kommt aus Investorenrunden und wird in Compute, Chips und Rechenzentren reinvestiert. Damit es weiterfließt, müssen die Stückkosten pro Anfrage entweder sinken oder die Umsätze steigen. In der Praxis sehen wir beides gleichzeitig.

Drei Mechanismen wirken parallel:

Tokenizer-Effekt: Mit Claude Opus 4.7 hat Anthropic im April 2026 einen neuen Tokenizer eingeführt, der für dieselbe Eingabe bis zu 35 % mehr Tokens generiert (3). Der Preis pro Token bleibt unverändert. Die effektive Rechnung pro Anfrage steigt trotzdem. Code, strukturierte Daten und nicht-englische Texte sind besonders betroffen.

Nutzungsgrenzen: Anthropic hat ab August 2025 wöchentliche Rate Limits für Claude Code eingeführt, mit getrennten Kontingenten für Opus und Sonnet (4). Wer in seiner Architektur immer das Flaggschiff aufruft, läuft schneller in das Limit als notwendig.

Long-Context-Premium: Anthropic erhebt für Inputs über 200.000 Tokens den doppelten Eingabepreis bei Opus und Sonnet (5). Wer große Dokumente oder lange Codebases ohne Vorverarbeitung in den Kontext schiebt, zahlt diesen Aufschlag bei jedem Aufruf.

Auf der Anwendungsseite zeigt sich das Problem noch deutlicher. Eine Auswertung der Claude-Code-Nutzung in der Community ergab, dass bei einem typischen Max-Nutzer rund 93,8 % aller Tokens auf das Opus-Modell entfielen, obwohl ein erheblicher Anteil davon Datei-Lesevorgänge, einfache Edits oder triviale Orchestrierungs-Calls waren (6). Konservativ geschätzt wären 60 bis 70 % dieser Tokens mit Sonnet oder Haiku in derselben Qualität zu erledigen gewesen. Bei API-Preisen entspricht das Einsparpotenzialen von 2.000 bis 3.000 US-Dollar pro Monat pro Heavy User.

Kurz gesagt: Das teuerste Modell für jede Aufgabe ist mittlerweile dieselbe Anti-Pattern wie ein Senior Partner, der Daten in Excel pflegt.

Drei Modell-Klassen, drei Zwecke

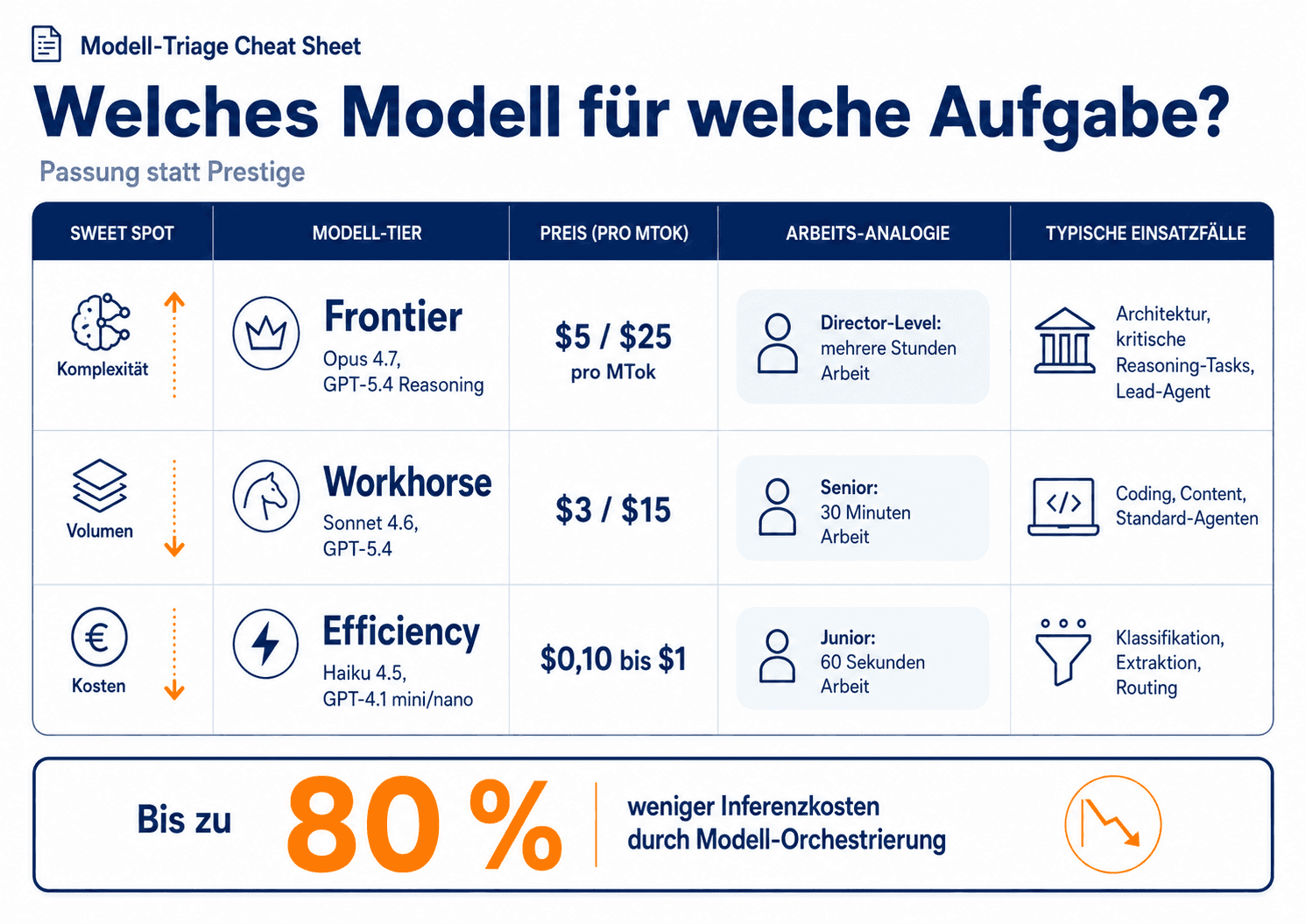

Die Anbieter haben ihre Portfolios klar in drei Leistungsklassen sortiert. Die Preise sprechen für sich und bilden die wirtschaftliche Grundlage jeder Modell-Strategie.

Frontier-Klasse (Claude Opus 4.7, GPT-5.4, Gemini Ultra). Für komplexe Architekturentscheidungen, Multi-Step-Reasoning, Agent-Teams und kritische Analysen. Claude Opus 4.7 kostet aktuell 5 US-Dollar pro Million Input-Tokens und 25 US-Dollar pro Million Output-Tokens (7). Hier zahlt sich die Investition aus, wenn die Aufgabenstellung wirklich Tiefe erfordert.

Workhorse-Klasse (Claude Sonnet 4.6, GPT-5.4 Standard). Der ökonomische Daily Driver. Sonnet 4.6 liegt bei 3 US-Dollar pro Million Input und 15 US-Dollar pro Million Output (7). In aktuellen Benchmarks bewältigt Sonnet 4.6 nach Anbieterangaben über 90 % typischer Coding-Aufgaben in vergleichbarer Qualität zum Vorgänger-Flaggschiff Opus 4.5 (8). Für die meisten Enterprise-Workloads ist das die richtige Default-Wahl.

Efficiency-Klasse (Claude Haiku 4.5, GPT-4.1 mini und nano). Für strukturierte, repetitive Aufgaben. Haiku 4.5 kostet 1 US-Dollar pro Million Input, GPT-4.1 nano sogar nur 0,10 US-Dollar (7). Bei hohen Volumina ist das ein bis zwei Größenordnungen günstiger als ein Frontier-Modell. Für Klassifikation, Extraktion oder einfache Routing-Entscheidungen reicht diese Klasse meist vollständig aus.

Wichtig ist die Größenordnung des Spreads. GPT-4o war für einfache Aufgaben 10- bis 50-mal teurer als ein vergleichbares kleines Modell (9). Wer 100.000 Klassifizierungen pro Tag fährt, spart bei korrekter Modellwahl nicht Cent-Beträge, sondern fünfstellige Summen pro Monat.

Praxisleitfaden: Welches Modell für welche Aufgabe

Die folgende Zuordnung basiert auf unseren Projekten der letzten zwölf Monate. Sie ist als Startpunkt zu verstehen, nicht als Dogma. Jeder konkrete Use Case sollte mit echten Daten getestet werden, bevor er produktiv geht.

Efficiency-Klasse (Haiku, Mini, Nano):

Klassifikation und Tagging: Tickets, E-Mails, Dokumente in Kategorien einordnen.

Strukturierte Extraktion: Felder aus Rechnungen, Verträgen, Formularen ziehen.

Sentiment-Analyse und einfache Stimmungserkennung in Texten oder Reviews.

Übersetzungen und einfache Formatierungen zwischen Sprachen oder Datenformaten.

Single-Hop-Q&A auf eindeutigen Datenquellen, etwa FAQ-Bot ohne Kontextketten.

Vorfilter in Agent-Pipelines: Erkennung, ob eine Anfrage überhaupt komplexe Bearbeitung benötigt.

Workhorse-Klasse (Sonnet, GPT-5.4 Standard):

Standard-Coding und Code-Reviews bis hin zu mittlerer Komplexität.

Content-Generation: Newsletter, Produkttexte, Berichte mit klarer Struktur.

Mehrstufige RAG-Pipelines mit moderaten Reasoning-Anforderungen.

Customer-Service-Agenten in der zweiten Eskalationsstufe.

Datenanalysen mit Interpretationsanteil, etwa Auswertung von Kundenfeedback.

Operative Sub-Agenten in Multi-Agent-Architekturen.

Frontier-Klasse (Opus, GPT-5.4 Reasoning, Gemini Ultra):

Architektur- und Strategieentscheidungen mit hoher Tragweite.

Komplexe Multi-Step-Reasoning-Aufgaben über lange Kontexte.

Agent-Teams als Lead-Modell, das andere Modelle orchestriert.

Vertragsanalysen, Compliance-Prüfungen, Risiko-Assessments mit nuancierter Bewertung.

Vision-Tasks mit hoher Auflösung, etwa technische Zeichnungen oder medizinische Bildanalyse.

Letzte Qualitätsprüfung vor Veröffentlichung kritischer Outputs.

Faustregel: Wenn ein menschlicher Junior die Aufgabe in 60 Sekunden lösen würde, gehört sie in die Efficiency-Klasse. Wenn ein erfahrener Senior 30 Minuten braucht, ist die Workhorse-Klasse richtig. Wenn ein Director-Level mehrere Stunden investieren würde, ist die Frontier-Klasse die richtige Wahl.

Orchestrierung in der Praxis

Wer drei Modellklassen einsetzen will, braucht eine Architektur, die das sinnvoll koordiniert. In unseren Projekten haben sich vier Bausteine etabliert.

Router-Layer. Ein vorgeschalteter Klassifikator entscheidet, an welches Modell eine Anfrage geht. In der einfachsten Form ist das eine Regel-Engine. Im fortgeschrittenen Setup ein dediziertes kleines Modell, das selbst routet. Im Schnitt nutzen Enterprise-Deployments aktuell drei bis sieben verschiedene Modelle parallel (9). Studien zeigen, dass intelligentes Routing die Inferenzkosten um 60 bis 80 % senken kann, ohne die Qualität spürbar zu beeinträchtigen (9).

Zwischenschicht für Daten und Zustand. Modelle haben kein Gedächtnis. Wer Agenten und Modelle vernetzt einsetzt, braucht eine persistente Datenebene. In der Praxis bewähren sich Notion, Airtable, Coda oder klassische Datenbanken wie Postgres als gemeinsamer Speicher. Hier liegen Zwischenergebnisse, Konversationszustände und strukturierte Daten, auf die alle Agenten zugreifen. Diese Schicht ist auch der Hebel, um zwischen verschiedenen Modellanbietern zu wechseln, ohne die gesamte Architektur neu zu bauen.

Caching und Batch. Beide großen Anbieter geben spürbare Rabatte für wiederholte Inhalte und asynchrone Verarbeitung. Prompt Caching reduziert die Kosten für gecachte Inputs um bis zu 90 %. Die Batch-API gewährt 50 % Rabatt bei einer Verarbeitungszeit von bis zu 24 Stunden (10). Für alle Workloads, die nicht in Echtzeit antworten müssen, ist Batch der einfachste Stellhebel.

Auto-Routing direkt im Modell. Anthropic bietet im Claude-Code-Umfeld den Modus „opusplan“, der in der Planungsphase automatisch Opus einsetzt und für die Umsetzung auf Sonnet wechselt (11). Tools wie Kiro gehen weiter und bieten einen Auto-Modus, der pro Aufgabe das passende Modell aus mehreren Anbietern wählt (12). Diese Funktionen ersetzen keine durchdachte Architektur, sind aber ein guter Startpunkt für Teams, die schnell erste Einsparungen heben wollen.

Unser Rat in der Reihenfolge: Erst die Klassifikation der eigenen Use Cases nach Komplexität. Dann die Modell-Zuordnung pro Klasse. Dann Routing und Caching. Erst danach kommen ausgeklügelte Auto-Modi.

Was das konkret bedeutet

Drei Empfehlungen, die in nahezu jedem KI-Projekt sofort wirken:

Default umstellen. Wenn Ihr Standard-Modell heute das Flaggschiff ist, setzen Sie es auf die Workhorse-Klasse zurück und definieren Sie eine bewusste Ausnahmeliste für Frontier-Aufgaben. In den meisten Fällen sinken die Kosten um 60 bis 80 % bei gleichbleibender Qualität (8, 9).

Token-Telemetrie einführen. Messen Sie pro Use Case, welches Modell wie viele Tokens verbraucht und welche Qualität liefert. Ohne diese Datenbasis sind alle Optimierungen Bauchgefühl. Cloud-FinOps-Tools oder einfache Logging-Pipelines reichen für den Anfang.

Zwischenschicht etablieren. Bevor Sie den dritten Agenten bauen, etablieren Sie eine persistente Datenebene. Notion oder Airtable reichen für den Start. Ohne diese Schicht bleibt jede Multi-Modell-Architektur fragil.

FAZIT

Die Phase, in der Modell-Auswahl ein Reflex war, ist vorbei. Anbieter werden ihre Preise weiter erhöhen, offen oder verdeckt. Gleichzeitig sind günstige Modelle so gut geworden, dass sie für den Großteil produktiver Aufgaben ausreichen. Wer jetzt eine bewusste Modell-Strategie aufsetzt, gewinnt an drei Stellen gleichzeitig: niedrigere Kosten, höhere Verfügbarkeit innerhalb der Rate Limits und resilientere Architekturen, die nicht an einem einzigen Anbieter hängen.

Die zentrale Frage für Entscheider ist daher nicht mehr „welches ist das beste Modell?“, sondern „welches Modell für welche Aufgabe in welcher Architektur?“ Wer diese Frage 2026 sauber beantwortet, hat einen strukturellen Vorteil, der mit jeder Preisrunde der Anbieter größer wird.

Quellen

(1) Fortune und WSJ, Dokumente zu OpenAI-Finanzplanung 2025 bis 2030, Nov. 2025

(2) European Business Magazine zu Anthropic Revenue und Series G, März 2026

(3) Anthropic Pricing Documentation und Finout-Analyse zu Claude Opus 4.7 Tokenizer

(4) TechCrunch und Anthropic, neue Weekly Rate Limits für Claude Code, Juli und August 2025

(5) Vantage, „Anthropic vs OpenAI: Comparing Direct API Costs“, März 2026

(6) GitHub Issue anthropics/claude-code #27665, Token-Verteilung Max-Subscriber, Feb. 2026

(7) Anthropic API Pricing Page und Pricepertoken.com, Stand Mai 2026

(8) Anthropic Claude Models Overview und Claudefast Model-Selection-Guide, Mai 2026

(9) OrchestrAI „LLM Orchestration Complete Guide“, März 2026

(10) Anthropic Documentation zu Prompt Caching und Batch API

(11) Anthropic Claude Code Model Configuration Docs, Mai 2026

(12) Kiro Docs „Models“, Auto-Routing-Funktion, Mai 2026